LIQID MATRIX

는 AI 인프라의 에너지 효율 표준을 재편하고 있습니다.

AI 인프라 평가 기준은 업계 리더들이 “데이터 센터의 새로운 화폐”라고 부르는 방향으로 변화하고 있습니다. 즉, 와트당 생성되는 토큰 수와 투자 금액당 생성되는 토큰 수를 합친 것입니다.

LIQID는 와트당 토큰 성능이 2배 향상되고, 기존 토큰당 달러 효율성은 절반 이상 향상되는 것으로 입증되었습니다.

초기 단계

2021년 이전

- 기성형 애플리케이션의 AI 기능

- 정적 서버 및 고정 GPU 구성

Big Prophecy Models(LLM)의 학습 시대

2021-2025

- LLM 교육에 집중된 하이퍼스케일 제조업체의 “토지 쟁탈”로 인해 GPU 부족 현상이 발생했습니다.

- 대규모 언어 모델이 주류가 되어가고 있습니다.

지역 추론 시대

2025년 이후

- 기성형 애플리케이션의 AI 기능

- 정적 서버 및 고정 GPU 구성

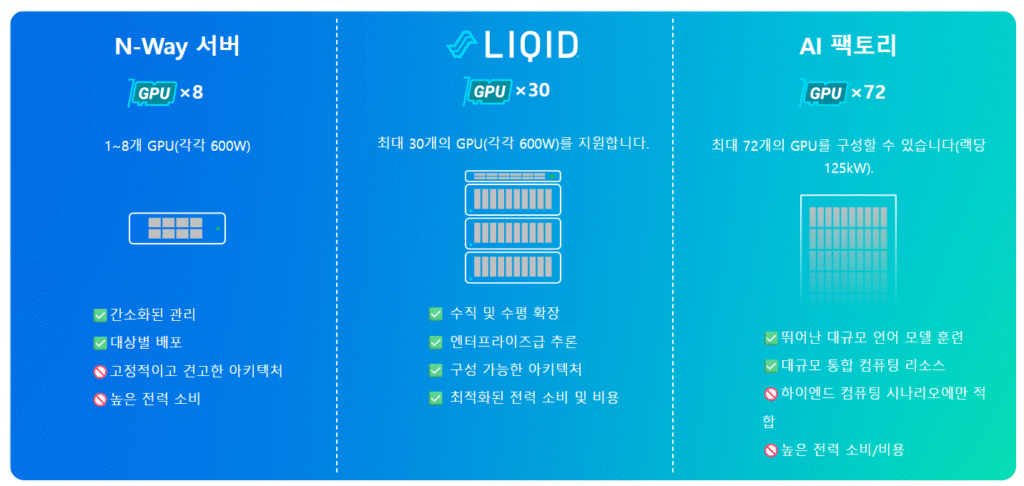

LIQID: 엔터프라이즈 GPU 인프라 격차 해소

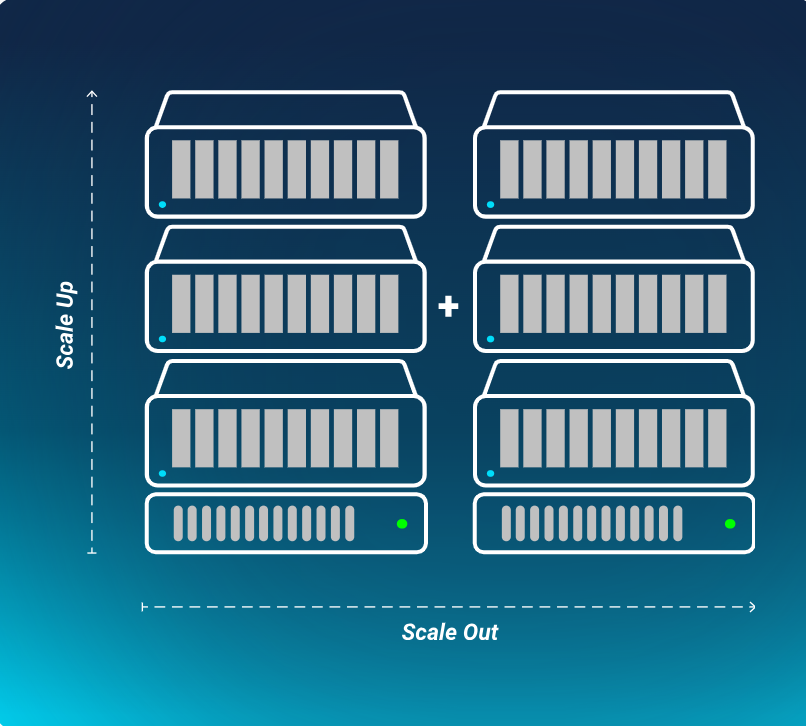

수직 확장 및 수평 확장

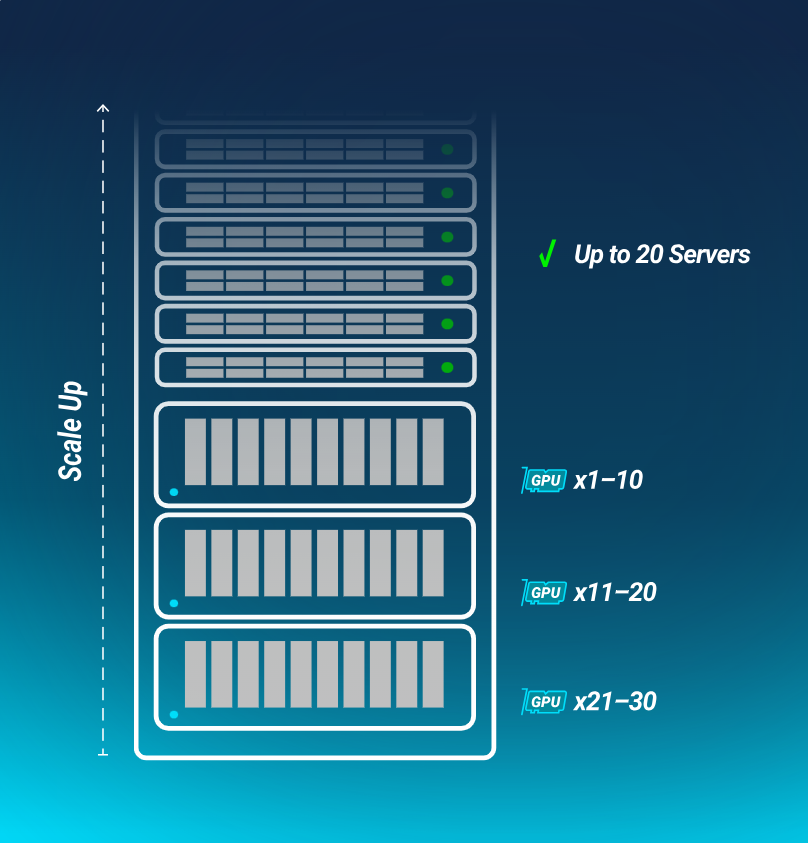

수직적 확장(Scale Up) : 단일 서버를 최대 30개의 GPU(NVIDIA H200, RTX Pro 6000 등 지원)로 확장하고, 메모리를 동적으로 할당하며, 초대형 AI 모델을 지원합니다.

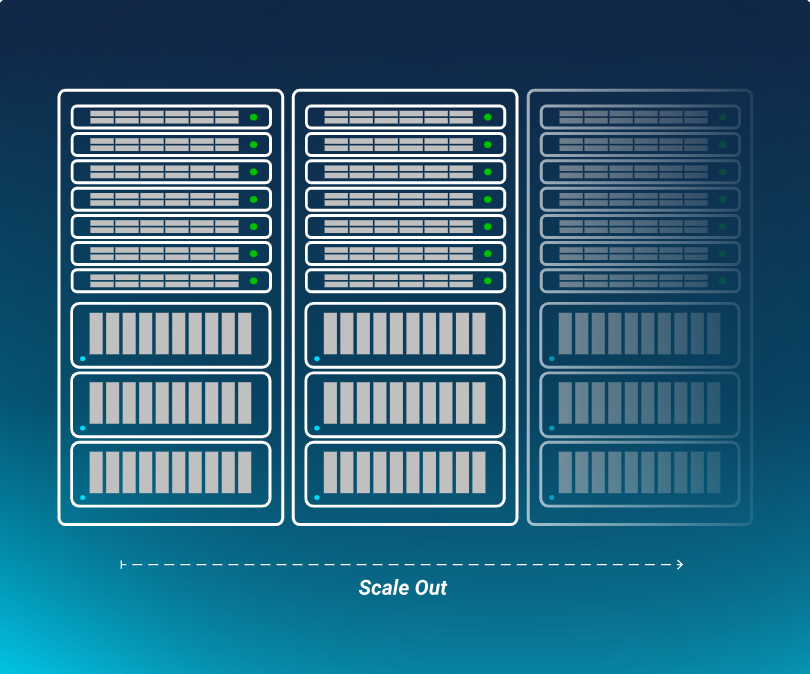

수평적 확장(Scale Out) : 개방형 아키텍처는 임의의 네트워크 구조를 지원하고, 다중 시스템 클러스터링은 값비싼 전용 AI 팩토리로 마이그레이션할 필요 없이 높은 성능을 달성합니다.

LIQID 수직 확장 솔루션

유연한 구성 : 클러스터 상호 연결 손실 없이 600W 고성능 장치(Intel Gaudi 3, d-Matrix 등)를 지원하는 1~30개 GPU를 즉시 배포합니다.

성능 최적화: NVMe 스토리지에 GPU를 직접 연결하여 AI/HPC 워크로드 성능을 30% 향상시키고 지연 시간을 단축합니다. 단일 CPU 호스트는 대규모 GPU + 메모리를 지원하여 하드웨어, 전력 소비 및 방열 요구 사항을 줄입니다.

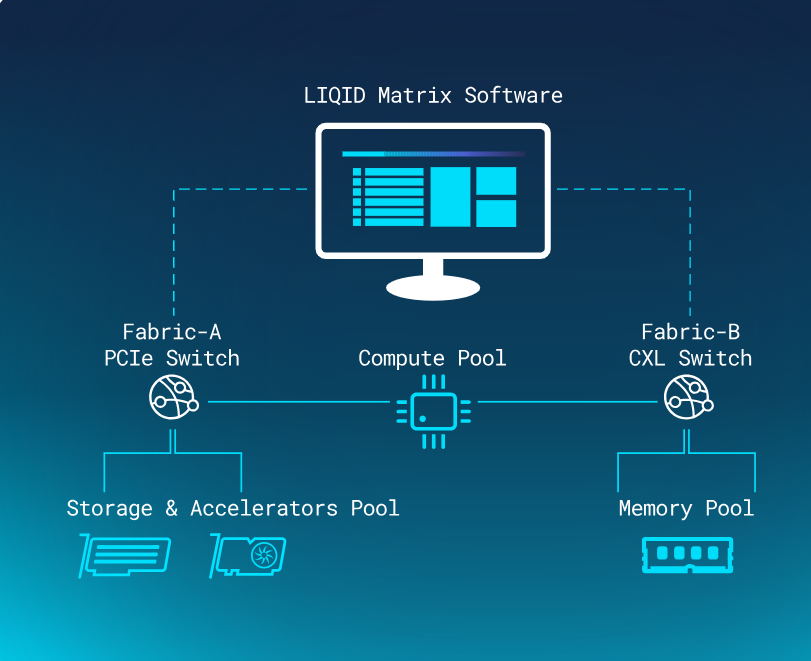

- 빠른 배포 : Liquid Matrix 소프트웨어를 사용하여 몇 초 만에 GPU, 메모리, 스토리지를 할당하여 작업 부하를 정확하게 맞춥니다.

LIQID 수평 확장 솔루션

개방형 표준을 기반으로 기존 네트워크 하드웨어와 프로토콜(예: RoCE v2/v3 및 InfiniBand)을 지원합니다.

Kubernetes, VMware, Slurm 등의 오케스트레이션 및 스케줄링 도구와 완벽하게 통합됩니다. 멀티 테넌시 및 부서 간 리소스 공유(예: 추론 모델/LLM 미세 조정)를 지원하여 고가용성(HA) 및 분산 관리를 제공합니다.

Nvidia Fusion 및 Ultra Ethernet과 같은 새로운 기술과 호환됩니다.

업계 최초이자 유일한 구성 가능하고 수직 확장 가능한 단일 인터페이스

수직 및 수평 확장을 모두 지원하여 GPU와 메모리의 구성을 가능하게 하는 업계 유일의 관리 인터페이스입니다.

소프트웨어 정의 정전과 결함이 있는 장치에 대한 가상 교체를 통해 가동 중지 시간을 줄일 수 있습니다.

그래픽 인터페이스나 REST API 작업을 통해 Kubernetes 및 Ansible과 같은 생태계 도구와 통합될 수 있습니다.

LIQID 사명 선언문: 로컬 및 에지 AI 인프라를 위한 에너지 효율 표준 재편

LIQID는 고효율, 저비용 AI 인프라 구축에 전념하고 있습니다.

- 에너지 효율 혁명: 전력 소비 단위당 토큰 생성량 100% 증가

- 비용 최적화: 단위 투자당 토큰 생성량이 50% 증가했습니다.